如果你現在還把 Nvidia 看成一家高階 GPU 公司,那其實只看到了表層。真正讓這家公司在生成式 AI 時代變得可怕的,不只是晶片本身的速度,而是它逐漸把整個 AI 基礎設施的價值衡量方式,從「每張卡多少 TFLOPS」改寫成「每單位電力與資本,能產出多少有商業價值的 token」。Jensen Huang 在 Dwarkesh Podcast 訪談 裡反覆強調的那句話——from electrons to tokens——聽起來像行銷口號,實際上卻是 Nvidia 商業模式最精準的濃縮:它賣的不是單一零件,而是把電子、資料、模型、網路、冷卻與軟體編排,全部轉化為可計價產出的整套工業系統。

這也是為什麼市場對 Nvidia 的爭論,早就不只是「H100 很強」那麼簡單。真正的問題是:Nvidia 的超額毛利與平台地位,到底是長期技術護城河,還是 AI 軍備競賽初期的短期寡占? 如果只是短缺紅利,那麼供給正常化之後,AMD、自研 ASIC 與雲端巨頭遲早會把價格打下來;但如果 Nvidia 已經在系統層、軟體層、供應鏈層與採購決策層建立了事實標準,那它的護城河就不是一條河,而是一整套被時間與複雜度加深的護城地形。

在 AI 時代,真正值錢的不是單純消耗電,而是能否以最低延遲、最低總成本,穩定把電子轉成 token。這句話表面上在講效率,骨子裡其實在講定價權。

一、先看數字:這不是一般半導體公司的財務輪廓

先把情緒拿掉,直接看財報。根據 NVIDIA 2025 財年第四季與全年財報,Nvidia 2025 財年全年營收達 1,305 億美元,年增 114%;其中資料中心營收達 1,152 億美元,年增 142%。單看第四季,公司營收 393 億美元,資料中心收入 356 億美元。更誇張的是,這家公司在如此激進的硬體擴張週期下,毛利率仍維持在低 70% 區間。對傳統半導體公司來說,這種成長速度搭配這種獲利結構,本身就已經很不尋常。

把這組數字與競爭對手放在一起看更有感。AMD 在 2024 全年財報 中指出,2024 全年營收約 258 億美元,資料中心業務 126 億美元,全年 Instinct 加速器營收超過 50 億美元。這已經是很漂亮的成績,但放到 Nvidia 面前,仍然像是另一個量級。這不是在說 AMD 沒進步,而是在說 Nvidia 所吃下的,不只是 AI 晶片需求,而是市場對「最穩、最快、最少風險的 AI 部署路徑」所願意支付的溢價。

也因此,Nvidia 當前最值得注意的,不只是營收暴增,而是 硬體公司竟然長出了接近軟體平台的毛利輪廓。這代表客戶買的不是一塊矽,而是把部署風險外包給 Nvidia 的能力。你可以把它理解成:在 AI 基礎設施這門生意裡,Nvidia 正在同時收取晶片毛利、系統整合毛利與時間不確定性的保費。

二、CUDA 為什麼可怕:它綁住的不是程式碼,而是組織時間

每次談 Nvidia 護城河,大家都會先提 CUDA。這當然沒錯,但很多分析把 CUDA 講得太像工具鏈,反而低估了它真正的價值。CUDA 自 2006 年推出以來,已經不是單純的開發語言或 API,而是一整套研究、訓練、推理、除錯、最佳化與人才培養的共同語境。PyTorch、TensorRT、cuDNN、各種模型最佳化庫與企業內部推理服務,很多都是圍繞 CUDA 演化。這表示企業若要切換平台,代價不只是重寫幾個 kernel,而是重做驗證流程、重建效能調校經驗、重訓工程團隊,甚至重新估算產品上市時程。

這也是為什麼替代方案常常在單點 benchmark 上看起來不差,但真進入大規模部署時卻卡關。對客戶來說,真正昂貴的不是買卡,而是 重新學一次怎麼把數千顆加速器變成可營運的服務。在 AI 軍備競賽最激烈的這幾年,時間本身就是稀缺資產。誰能讓客戶更快上線、更少踩坑,誰就能收走最大部分的經濟租。CUDA 因此不只是技術標準,更是市場對不確定性的避風港。

三、從 GPU 公司到 AI 工廠總包商:Blackwell 的真正訊號

如果 CUDA 是第一層鎖定,那麼更深的一層是系統整合。根據 GTC 2024 主題演講整理 與 Hot Chips 2024 技術說明,Blackwell 平台不是一顆 GPU,而是一整個由 Blackwell GPU、Grace CPU、BlueField DPU、ConnectX NIC、NVLink Switch、Spectrum Ethernet 與 Quantum InfiniBand 共同構成的基礎設施。GB200 NVL72 更把 72 顆 Blackwell GPU 與 36 顆 Grace CPU 組成單一 rack-scale system。黃仁勳在舞台上說這像「一個 giant GPU」,這不是誇飾,而是在重新定義買方該如何理解算力。

這個轉變非常關鍵。過去資料中心比較像採購伺服器零件;現在超大模型客戶買的是吞吐量、延遲、穩定性與可擴展性。當工作負載變成萬卡級訓練與高併發推理之後,瓶頸往往不是單卡 FLOPS,而是模型切分、GPU 間通訊、跨機櫃互連、機房供電與散熱。Nvidia 的厲害,不在於它把每個元件都做到世界第一,而在於它把這些元件 包成一套能被客戶直接採購的答案。這會大幅改變競爭維度:對手不再只需要做出更快的晶片,而是要交付一套可在現實世界穩定運轉的工業系統。

更重要的是,這種 rack-scale 產品把 Nvidia 從零件供應商推向類似「AI 工廠總包商」的位置。當客戶買的是整櫃、整區域、整個 AI factory 的產能,Nvidia 就更像在賣一條產線,而不是在賣單一設備。這會自然強化它的議價能力,因為你議價的對象不再是某顆 GPU 的 BOM 成本,而是整條產線是否能如期投產。

四、為什麼 Jensen 一直講 token:因為 TCO 才是真正的價格戰場

很多人看到 H100、H200 或 B200 的單價,就直覺認為這遲早會逼出便宜替代品。這個直覺在 PC 或傳統伺服器市場也許成立,但 AI 基建更接近重工業投資,採購決策核心是 TCO,也就是總持有成本。訓練一個大型模型,需要多久?推理一百萬個 token 耗多少電?要達到相同吞吐量需要多少機櫃、多少工程師、多少液冷改造?如果切換到較便宜但生態較弱的平台,延後產品上線三到六個月,這個機會成本又值多少?

從這個角度看,Nvidia 的高價其實建立在一個很簡單的論點上:貴,不等於總成本高;便宜,也可能是最昂貴的選項。 Hot Chips 的材料提到,GB200 NVL72 針對大型語言模型推理可帶來最高 30 倍更快的推理能力;GTC 的敘事則把焦點放在低延遲、高吞吐 token generation。這些說法的核心都是同一件事:當 AI 應用開始大規模商業化,企業最在意的不是買到最便宜的卡,而是每一度電、每一平方英尺與每一位工程師,能換回多少可出售的推理能力。

這也解釋了為什麼 Nvidia 正試圖把市場的估值語言從 CapEx 轉成經濟產能。它不是在說「我的 GPU 比別人強」,而是在說「我的系統能幫你更便宜地生產 token」。一旦市場接受這套說法,Nvidia 拿到的就不只是硬體溢價,而是類似工業設備商按產出能力定價的話語權。

五、供應鏈其實也是護城河:CoWoS、HBM、液冷與電網都算

談 Nvidia,不能只談晶片設計,還要談它如何把整條供應鏈綁進自己的節奏。AI 加速器的關鍵零件包括先進封裝、HBM 高頻寬記憶體、網通、主機板、液冷模組與資料中心電力改造。這些環節任何一個出問題,都會拖慢整個系統出貨。表面上看,這似乎是 Nvidia 的弱點;但換個角度,它也同時構成了進入門檻。不是任何新玩家都能同時協調 TSMC、SK hynix、美光、系統整合商、交換器廠、液冷供應商與超大客戶的上架節奏。

更麻煩的是,AI 資料中心正在從傳統空冷機房,走向 100kW 以上功率密度的高熱密度設施。根據 Nvidia 在 Hot Chips 的公開材料,GB200 NVL72 這類系統已把市場焦點推向液冷、冷卻分配單元與機房 retrofit。這意味著未來的瓶頸不只是矽,還可能是水、電、管線、工班與地方電網。黃仁勳幾次受訪時提到,限制資料中心擴張的常常不是晶片,而是電工與水管工。這句話聽起來很接地氣,但點出了殘酷現實:AI 基建已經開始像重工業,而不只是 IT 採購。

當產業走到這一步,Nvidia 的定位就再次升級。它不只是在爭取晶片訂單,而是在提前定義整個產業的材料流、資本流與施工節奏。能夠先卡住規格、先綁住供應、先讓生態跟著自己的產品週期走,本身就是護城河的一部分。

六、競爭者在哪裡:AMD、自研 ASIC 與第二供應商邏輯

如果只寫成 Nvidia 無敵,那就有點偷懶。競爭者其實都在,而且邏輯不一樣。最現實的外部挑戰者仍然是 AMD。從硬體規格看,MI300X 與後續產品在記憶體容量與某些推理工作負載上具備吸引力;根據 SemiAnalysis 的 AMD vs. NVIDIA 推理比較,不同延遲與工作負載條件下,AMD 在某些場景的 performance per dollar 已經不是不能看,只是整體上仍難撼動 Nvidia 在租賃市場與生態成熟度上的優勢。

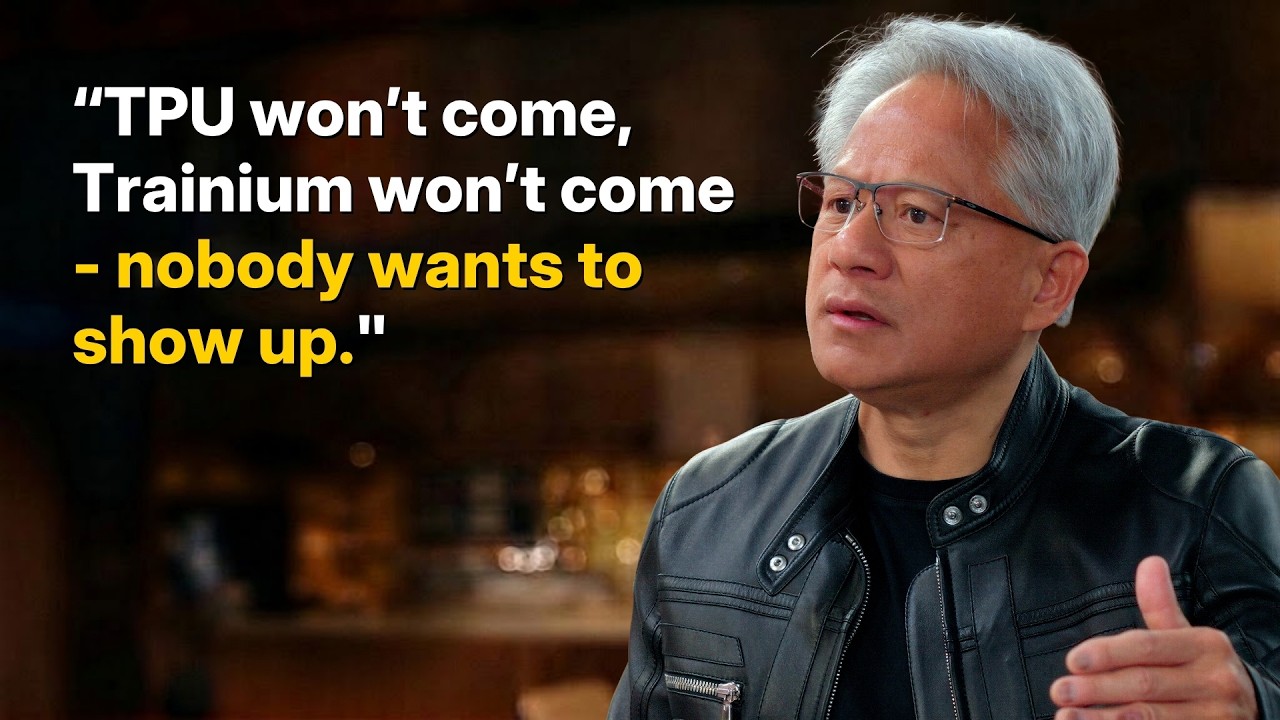

另一方面,超大雲與超大模型公司也不會甘願永遠被 Nvidia 綁住。Google 有 TPU,AWS 有 Trainium 與 Inferentia,Microsoft 有 Maia,Meta 也持續投資自研加速器。這些路線的戰略意義,未必是短期內全面打敗 Nvidia,而是把最標準化、最可預測的工作負載拉回內部,藉此降低對 Nvidia 的依賴,並在談判桌上拿回一點主動權。換句話說,客戶想要的常常不是「取代 Nvidia」,而是 把 Nvidia 從唯一答案變成最佳但非唯一的答案。

這件事對 Nvidia 很重要,因為一旦市場形成 second-source 心態,護城河雖不會立刻消失,但價格權就可能慢慢鬆動。不過短中期內,替代者仍有兩大難關:第一是軟體堆疊與工具鏈成熟度;第二是大規模跨節點系統整合能力。很多對手已經能做出「不錯的晶片」,但離「讓全球企業放心上線的完整平台」仍有距離。

七、最深的護城河也許不是 CUDA,而是速度

若只看某一代產品,很容易低估 Nvidia。它真正讓人頭痛的地方,是把自己調整成一台高頻節奏機器:Volta、Ampere、Hopper、Blackwell,後面還有 Rubin,並且每一代都不是單點升級,而是 GPU、互連、網路、系統與軟體一起前進。這種節奏的可怕之處在於,當競爭對手剛追上某一代產品,市場已經開始為下一代做最佳化。

速度會帶來兩種鎖定。第一種是採購鎖定:大客戶會按照 Nvidia 的 roadmap 規劃資料中心投資,因為那是目前最清楚、最有確定性的路。第二種是生態鎖定:研究人員、框架作者、模型公司與雲服務商,會優先對最可能成為主流的架構進行最佳化。久而久之,Nvidia 的優勢就不只來自當下產品更強,而是來自它 持續定義大家下一步要往哪裡走。當一家公司從領先者變成產業節奏制定者,挑戰它的難度就會呈指數上升。

八、真正的大風險:地緣政治會不會把這個飛輪拆開?

Nvidia 面對的最大外生變數,未必來自 AMD,而更可能來自政策。AI 晶片早已不是普通商品,而是帶有國安、產業政策與地緣競爭意義的戰略資產。美國對中國的高階 AI 晶片出口限制,短期內固然有助於維持美國陣營的技術領先,但它同時也有副作用:一方面限制 Nvidia 可服務的市場,另一方面迫使中國與全球其他買方更積極尋找替代路線。

2025 年 4 月市場就曾關注 H20 出口限制升級對 Nvidia 的衝擊。即便不討論單一事件細節,方向已經很清楚:政策既保護 Nvidia,也在某些區域削弱 Nvidia。 對投資人來說,這意味著護城河不是靜態資產,而是一套會被政治力量改變形狀的工業系統。全球越碎片化,Nvidia 越需要把自己的軟體與系統規格固化成跨區域的共同標準,否則它的飛輪效率就會被折損。

九、看多、看空、中立:怎麼更誠實地評估 Nvidia?

- 看多: AI 資本支出仍在早期,需求正從訓練延伸到推理、代理式工作流、主權 AI 與企業內部模型服務。只要全球還在蓋 AI 工廠,最完整的系統供應商就最容易吃下最大份額。

- 看空: 超高毛利終究會吸引更多替代者;雲端巨頭有強烈動機把部分工作負載轉向自研 ASIC;當供應鏈放鬆、租賃市場成熟、軟體工具更抽象化後,Nvidia 的價格權可能逐步下修。

- 中立: Nvidia 的護城河是真的,但市場有時把「真的」誤讀成「永遠不會被侵蝕」。更合理的看法是:它在未來三到五年仍然很深,但很難永久維持今天這種近乎神話的議價能力。

我自己的判斷比較接近中立偏多。Nvidia 的優勢並不只是一顆更快的 GPU,而是它把軟體、生態、互連、供應鏈、冷卻與資料中心敘事全部包成一個客戶願意高價購買的確定性產品。這種優勢很難在一兩個產品週期內被打穿。但若把時間拉長,任何過高的利潤池都會吸引資本、人才與政策一起進場侵蝕。真正需要持續觀察的,不是單季訂單,而是 Nvidia 是否仍在定義整個產業如何衡量、採購與部署 AI 算力。只要這件事還成立,它就不只是受益者,而是規則制定者。

十、為什麼這很重要:Nvidia 正在定義 AI 時代的資本支出單位

過去十年,雲端改變的是企業如何購買 IT:從買伺服器,變成買服務。AI 下一步可能改變的是,企業不再只買算力,而是買 token 產能、買模型延遲、買推理效率與買部署速度。若這個判斷成立,那麼 Nvidia 真正厲害的地方,就不是賣出幾百萬張高價 GPU,而是用自己的產品架構,重新定義了未來資料中心資本支出的共同語言。

你可以把這家公司想成一個新的翻譯器:它把半導體、網路、電力、冷卻、封裝與軟體,全都翻譯成 CFO 與 CEO 聽得懂的產能語言——每投入一單位資本,能穩定產出多少 token。當市場開始用這種方式思考,Nvidia 的護城河就不再只是產品優勢,而是 計價權、定義權與時間優勢的疊加。這也是為什麼大家看起來都在學它:晶片公司想做平台,雲端公司想做 ASIC,伺服器廠想升級成解決方案商,資料中心業者則試圖把自己包裝成 AI factory。

延伸思考:真正要擊敗 Nvidia,需要什麼?

如果把問題收斂成一句話:要怎樣才能打敗今天的 Nvidia?答案恐怕不是做出一顆更快的晶片,而是提供另一套足夠完整、足夠可信、足夠能被全球大客戶放心採購的工業系統。你需要成熟的軟體堆疊、穩定的互連、可擴展的系統設計、能拿到的先進封裝與 HBM、可快速落地的資料中心改造方案,以及一條不會被政策瞬間卡死的供應路線。這不是單點創新問題,而是體系戰。

這也是本文最核心的結論:Nvidia 的護城河在晶片層未必永遠無敵,但在系統層、組織層與產業節奏層,確實比很多人以為的更深。 穿皮衣的煉金術士真正煉成的不是 GPU,而是一個讓全產業按照它的節奏蓋 AI 工廠、改資料中心、重寫成本模型的商業秩序。只要這套秩序還在運轉,Nvidia 就不只是賣鏟人,而是 AI 時代最有權力定義「鏟子」長什麼樣子的公司。

延伸閱讀

- Dwarkesh Podcast:Jensen Huang 深度訪談 —— 最直接理解黃仁勳如何把 AI、供應鏈與 geopolitics 放進同一個敘事框架。

- NVIDIA FY2025 財報 —— 看懂資料中心營收、毛利率與 Blackwell 出貨節奏最關鍵的原始資料。

- GTC 2024:Blackwell 與 NIM —— 從官方角度理解 Nvidia 為何把自己定位成 AI 基礎設施公司。

- Hot Chips 2024:GB200 NVL72 與液冷 —— 看 rack-scale system、NVLink 與液冷基建如何一起變成競爭門檻。

- SemiAnalysis:AMD vs. NVIDIA 推理性價比 —— 理解替代路線不是不存在,而是仍受限於系統成熟度與市場部署現實。